Google tente de faire des vagues avec Gemini, sa suite phare de modèles, d’applications et de services génératifs d’IA. Mais qu’est-ce que Gemini ? Comment pouvez-vous l’utiliser ? Et comment s’accumulent-il à d’autres outils d’IA génératives tels que ChatGPT d’OpenAI, Meta’s Llama et Copilot de Microsoft ?

Pour faciliter le suivi des derniers développements de Gemini, nous avons mis en place ce guide pratique, que nous tiendrons à jour en tant que nouveaux modèles, fonctionnalités et nouvelles de Gémeaux sur les plans de Google pour Gemini.

Qu’est-ce que Gemini?

Gemini est la famille de modèles d’IA de révolution générative de Google à nouveau. Développé par les laboratoires de recherche sur l’IA de Google, DeepMind et Google Research, il présente quatre saveurs:

- Gemini Ultra

- Gemini Pro

- Gemini Flash, une version plus rapide, « distillée » de Pro. Il est également disponible dans une version légèrement plus petite et plus rapide, appelée Gemini Flash-8B.

- Gemini Nano, deux petits modèles: Nano-1 et Nano-2 un peu plus capable, qui est censé s’épuiser hors ligne

Tous les modèles Gemini ont été formés pour être natif, c’est-à-dire capables de travailler et d’analyser plus que de simples textes. Google dit qu’ils ont été pré-entraînés et ajustés sur une variété d’images et de vidéos publiques, propriétaires et sous licence, d’une série de bases de codes et de texte dans différentes langues.

Cela distingue Gemini de modèles tels que le LaMDA de Google, qui a été formé exclusivement sur les données textuelles. LaMDA ne peut pas comprendre ou générer quoi que ce soit au-delà du texte (par exemple, des essais, des courriels, etc.), mais ce n’est pas nécessairement le cas avec les modèles Gemini.

Nous noterons ici que l’éthique et la légalité des modèles de formation sur les données publiques, dans certains cas à l’insu des détenteurs de données ou sans le consentement, sont obscures. Google a une politique d’indemnisation en matière d’IA pour protéger certains clients de Google Cloud des procès s’ils y font face, mais cette politique contient des découpages. Procédez avec prudence, en particulier si vous avez l’intention d’utiliser Gemini à des fins commerciales.

Quelle est la différence entre les applications Gemini et les modèles Gemini ?

Gemini est séparé et distinct des applications Gemini sur le web et le mobile (anciennement Bard).

Les applications Gemini sont des clients qui se connectent à divers modèles de Gemini et superposent une interface de type chatbot. Pensez-y comme des objectifs principaux de l’IA génératrice de Google, analogue à ChatGPT et à la famille d’applications Claude d’Anthropic.

Gémeaux sur le web vit ici. Sur Android, l’application Gemini remplace l’application Google Assistant existante. Et sur iOS, les applications Google et Google Search servent de clients Gemini de cette plateforme.

Sur Android, il est également devenu récemment possible d’apporter le superposition Gemini au-dessus de n’importe quelle application pour poser des questions sur ce qui est à l’écran (par exemple, une vidéo YouTube). Il suffit d’appuyer sur le bouton d’alimentation d’un smartphone soutenu ou de dire, « Heur Google »; vous verrez la superposition apparaître.

Les applications Gemini peuvent accepter des images ainsi que des commandes vocales et du texte – y compris des fichiers tels que des PDF et bientôt des vidéos, téléchargées ou importées à partir de Google Drive – et générer des images. Comme on pouvait s’y attendre, les conversations avec les applications Gemini sur mobile se reportent à Gemini sur le web et vice versa si vous êtes connecté au même compte Google à deux endroits.

Une recommandation de la redaction: Fact-checking Dame Joe’s high profile defense case

Gemini Avancé

Les applications Gemini ne sont pas le seul moyen de recruter l’aide des modèles Gemini pour les tâches. Lentement mais sûrement, les fonctionnalités d’abus Gemini-imbued font leur chemin dans les applications et les services Google de base comme Gmail et Google Docs.

Pour profiter de la plupart d’entre eux, vous aurez besoin du plan Google One AI Premium. Techniquement, qui fait partie de Google One, le plan Premium d’IA coûte 20 dollars et donne accès à Gemini dans des applications Google Workspace comme Docs, Maps, Slides, Sheets, Drive, et Meet. Il permet également ce que Google appelle Gemini Advanced, qui apporte les modèles Gemini plus sophistiqués de la société aux applications Gemini.

Les utilisateurs de Gemini Advanced obtiennent des extras ici et là aussi, comme un accès prioritaire à de nouvelles fonctionnalités, la possibilité d’exécuter et d’éditer le code Python directement dans Gemini, et une « fenêtre contextuelle » plus large. Gemini Advanced peut se souvenir du contenu de – et de la raison à travers – environ 750 000 mots dans une conversation (ou 1 500 pages de documents). C’est comparé aux 24 000 mots (ou 48 pages) que l’application vanille Gemini peut gérer.

Gemini Advanced donne également aux utilisateurs l’accès à la nouvelle fonctionnalité Deep Research de Google, qui utilise un « raisonnement avancé » et des « capacités de contexte long » pour générer des notes de recherche. Après avoir demandé au chatbot, il crée un plan de recherche en plusieurs étapes, vous demande de l’approuver, puis Gemini met quelques minutes à la recherche sur le web et à générer un rapport complet basé sur votre requête. Il est destiné à répondre à des questions plus complexes telles que : « Pouvez-vous m’aider à redessiner ma cuisine ? »

Google offre également aux utilisateurs de Gemini Advanced une fonction de mémoire, qui permet au chatbot d’utiliser vos anciennes conversations avec Gemini comme contexte pour votre conversation actuelle.

Une autre exclusive Gemini Advanced est la planification de voyage dans Google Search, qui crée des itinéraires de voyage personnalisés à partir d’invites. Prenant en compte des moments de vol (à partir des e-mails dans la boîte Gmail d’un utilisateur), des préférences alimentaires et des informations sur les attractions locales (de Google Search et des cartes de Google), ainsi que des distances entre ces attractions, Gemini générera un itinéraire qui se met à jour automatiquement pour refléter tout changement.

Les services de Gemini sont également accessibles aux entreprises par le biais de deux plans, Gemini Business (un add-on pour Google Workspace) et Gemini Enterprise. Les coûts commerciaux de Gemini coûtent aussi peu que 6 dollars par utilisateur et par mois, tandis que Gemini Enterprise, qui ajoute la prise de notes de réunion et les légendes traduites ainsi que la classification et l’étiquetage des documents, est généralement plus cher, mais est à la demande en fonction des besoins d’une entreprise. (Les deux plans exigent un engagement annuel.)

Gémeaux dans Gmail, Docs, Chrome, dev tools, et plus

Dans Gmail, Gemini vit dans un panneau latéral qui peut écrire des courriels et résumer les fils de message. Vous trouverez le même panneau dans Docs, où il vous aide à écrire et à affiner votre contenu et à réfléchir à de nouvelles idées. Gemini dans Slides génère des diapositives et des images personnalisées. Et Gemini dans Google Sheets suit et organise les données, créant des tables et des formules.

Le chatbot de l’IA de Google est récemment venu à Maps, où Gemini peut résumer les critiques sur les cafés ou proposer des recommandations sur la façon de passer une journée à visiter une ville étrangère.

La portée de Gemini s’étend également à Drive, où il peut résumer les fichiers et les dossiers et donner rapidement des faits sur un projet. Dans Meet, pendant ce temps, Gemini traduit les légendes dans des langues supplémentaires.

Gemini est récemment venu sur le navigateur Chrome de Google sous la forme d’un outil d’écriture d’IA. Vous pouvez l’utiliser pour écrire quelque chose de complètement nouveau ou réécrire le texte existant ; Google dit qu’il considérera la page web sur laquelle vous êtes pour faire des recommandations.

Ailleurs, vous trouverez des indications de Gemini dans les produits de base de données de Google, les outils de sécurité en nuage et les plateformes de développement d’applications (y compris Firebase et Project IDX), ainsi que dans des applications comme Google Photos (où Gemini gère les requêtes de recherche en langage naturel), YouTube (où il aide à réfléchir à des idées vidéo), et l’assistant de prise de notes NotebookLM.

Code Assist (anciennement Duet AI for Developers), la suite d’outils d’assistance alimentés par l’IA de Google pour l’achèvement et la génération de code, décharge le levage informatique lourd à Gemini. Il en va de même des produits de sécurité de Google soutenus par Gemini, comme Gemini dans le renseignement sur les menaces, qui peut analyser de grandes parties de code potentiellement malveillant et permettre aux utilisateurs d’effectuer des recherches en langage naturel pour les menaces ou les indicateurs de compromis en cours.

Extensions et gemmes de Gémeaux

Annoncés à Google I/O 2024, les utilisateurs de Gemini Advanced peuvent créer des gemmes, des chatbots personnalisés alimentés par des modèles Gemini. Les gemmes peuvent être générées à partir de descriptions de langage naturel – par exemple, «Vous êtes mon coach de course. Donnez-moi un plan de course quotidien » – et partagez-le avec d’autres personnes ou tenu en privé.

Des gemmes sont disponibles sur ordinateur et mobile dans 150 pays et dans la plupart des langues. En fin de compte, ils pourront exploiter un ensemble étendu d’intégrations avec les services de Google, y compris Google Calendar, Tasks, Keep et YouTube Music, pour effectuer des tâches personnalisées.

En parlant d’intégrations, les applications Gemini sur le web et le mobile peuvent puiser dans les services Google via ce que Google appelle les « extensions Gemini ». Gemini s’intègre aujourd’hui à Google Drive, Gmail et YouTube pour répondre à des questions telles que « Pourriez-vous résumer mes trois derniers courriels ? ». Plus tard dans l’année, Gemini sera en mesure de prendre des actions supplémentaires avec Google Calendar, Keep, Tasks, YouTube Music and Utilities, les applications exclusives Android qui contrôlent des fonctionnalités sur les dispositifs comme les minuteries et les alarmes, les contrôles multimédias, la lampe flash, le volume, le Wi-Fi, le Bluetooth, et ainsi de suite.

Gémeaux de discussion en direct en profondeur

Une expérience appelée Gemini Live permet aux utilisateurs d’avoir des discussions vocales « en profondeur » avec Gemini. Il est disponible dans les applications Gemini sur mobile et dans le Pixel Buds Pro 2, où il peut être consulté même lorsque votre téléphone est verrouillé.

Avec Gemini Live activé, vous pouvez interrompre Gemini pendant que le chatbot parlant (dans l’une des nouvelles voix) pour poser une question de clarification, et il s’adaptera à vos schémas de parole en temps réel. À un moment donné, Gemini est censé acquérir une compréhension visuelle, lui permettant de voir et de répondre à votre environnement, soit via des photos ou des vidéos capturées par les caméras de vos smartphones.

Live est également conçu pour servir de coach virtuel en quelque sorte, vous aidant à répéter pour les événements, réfléchir aux idées, etc. Par exemple, Live peut suggérer quelles compétences mettre en évidence lors d’un prochain entretien d’emploi ou de stage, et il peut donner des conseils d’expression orale en public.

Vous pouvez lire notre revue de Gemini Live ici. Altence de spoiler: Nous pensons que la fonctionnalité a des moyens d’aller avant qu’elle ne soit super utile – mais c’est les premiers jours, il est vrai.

Génération d’images via Imagen 3

Les utilisateurs de Gemini peuvent générer des illustrations et des images en utilisant le modèle intégré Imagen 3 de Google.

Google dit qu’Imagen 3 peut mieux comprendre le texte qu’il traduit en images par rapport à son prédécesseur, Imagen 2, et est plus « créatif et détaillé » dans ses générations. En outre, le modèle produit moins d’artefacts et d’erreurs visuelles (du moins selon Google), et est le meilleur modèle Imagen pour le rendu du texte.

En février, Google a été contraint de suspendre la capacité de Gemini à générer des images de personnes après que les utilisateurs se sont plaints d’inexactitudes historiques. Mais en août, la société a réintroduit la génération de personnes pour certains utilisateurs, en particulier les utilisateurs en anglais, s’est inscrite à l’un des plans Gemini payés de Google (par exemple, Gemini Advanced) dans le cadre d’un programme pilote.

Gémeaux pour les adolescents

En juin, Google a introduit une expérience Gemini axée sur les adolescents, permettant aux étudiants de s’inscrire via leur compte Google Workspace for Education.

Le Gemini axé sur les adolescents a des « politiques et des garanties supplémentaires », y compris un processus d’intégration sur mesure et un « guide de l’IA pour l’alphabétisation » (en tant que Google le dit) « aider les adolescents à utiliser l’IA de manière responsable ». Sinon, il est presque identique à l’expérience Gemini standard, jusqu’à la fonction « double contrôle » qui regarde sur le web pour voir si les réponses de Gemini sont exactes.

Gémeaux dans les appareils ménagers intelligents

Un nombre croissant d’appareils fabriqués par Google sur Gémeaux pour améliorer la fonctionnalité, du Google TV Streamer aux Pixel 9 et 9 Pro en passant par le nouveau Nest Learning Thermostat.

Sur le Google TV Streamer, Gemini utilise vos préférences pour organiser des suggestions de contenu dans vos abonnements et résumer les critiques et même des saisons entières de télévision.

Sur le dernier thermostat Nest (ainsi que les haut-parleurs Nest, les caméras et les écrans intelligents), Gemini renforcera bientôt les capacités de conversation et d’analyse de Google Assistant.

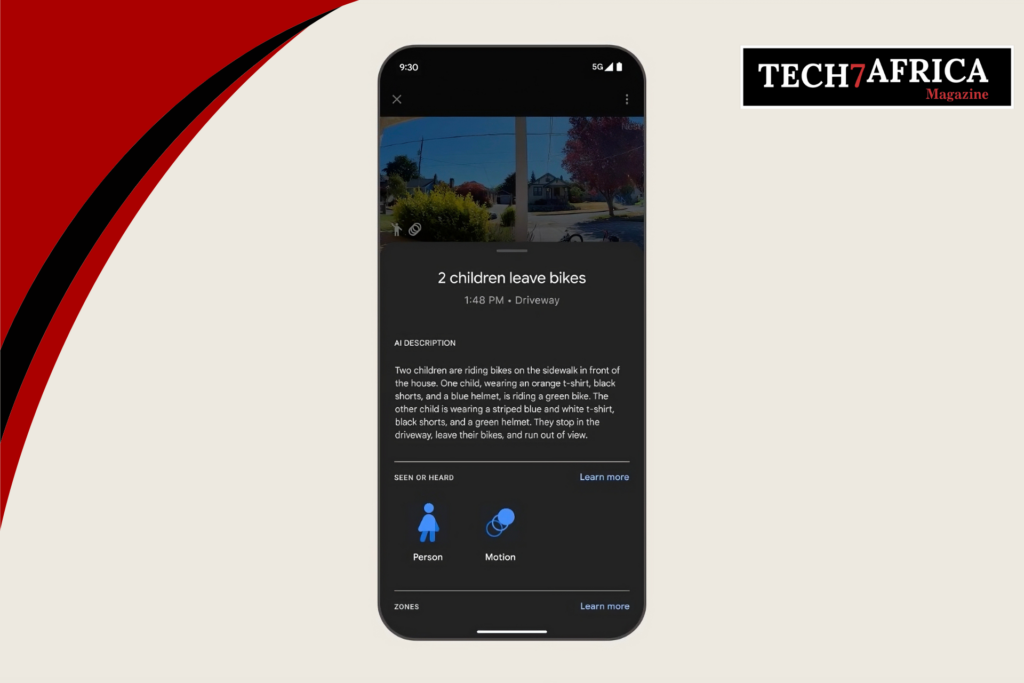

Les abonnés au plan Nest Aware de Google plus tard dans l’année recevront un aperçu de nouvelles expériences alimentées par Gemini comme les descriptions d’IA pour les images de la caméra Nest, la recherche vidéo en langage naturel et les automatisations recommandées. Les caméras Nest comprendront ce qui se passe dans les flux vidéo en temps réel (par exemple, lorsque le chien creuse dans le jardin), tandis que l’application Google Home compagnon sur les vidéos et créera des automatisations d’appareils donné une description (par exemple, « Les enfants ont-ils laissé leurs vélos dans l’allée ? », « J’ai-je sorti mon thermostat Nest allumer le chauffage quand je rentrerai du travail tous les mardis »).

Plus tard dans l’année également, Google Assistant recevra quelques mises à jour sur Nest-anded et d’autres appareils domestiques intelligents pour rendre les conversations plus naturelles. Des voix améliorées sont en cours, en plus de la possibilité de poser des questions de suivi et de faire des allers-retours sans doute.

Que peuvent faire les modèles Gemini ?

Parce que les modèles Gemini sont multimodaux, ils peuvent effectuer une gamme de tâches multimodales, allant de la transcription de la parole à la sous-titre d’images et de vidéos en temps réel. Beaucoup de ces capacités ont atteint le stade du produit (comme cela a été mentionné dans la section précédente), et Google promet beaucoup plus dans un avenir pas trop lointain.

Bien sûr, c’est un peu difficile de prendre la société au mot. Google a été gravement sous-aramé lors du lancement original de Bard. Plus récemment, il a ébouriffé des plumes avec une vidéo censée montrer les capacités de Gemini qui était plus ou moins ambitieuse – pas en direct.

En outre, Google n’offre aucune solution pour certains des problèmes sous-jacents avec la technologie générative d’Al aujourd’hui, comme ses biais codés et sa tendance à inculquier les choses (c’est-à-dire l’hallucinate). Ni ses rivaux, mais c’est quelque chose à garder à l’esprit lorsque l’on envisage d’utiliser ou de payer pour Gemini.

En supposant, dans les objectifs de cet article, Google est véridique par ses récentes affirmations, voici ce que les différents niveaux de Gemini peuvent faire maintenant et ce qu’ils seront en mesure de faire une fois qu’ils auront atteint leur plein potentiel :

Ce que vous pouvez faire avec Gemini Ultra

Google dit que Gemini Ultra – grâce à sa multimodalité – peut être utilisé pour aider à faire des devoirs de physique, à résoudre les problèmes étape par étape sur une feuille de calcul, et à signaler d’éventuelles erreurs dans les réponses déjà remplies.

Ultra peut également être appliqué à des tâches telles que l’identification d’articles scientifiques pertinents pour un problème, explique Google. Le modèle peut extraire des informations de plusieurs articles, par exemple, et mettre à jour un graphique à partir de l’un en générant les formules nécessaires pour recréer le graphique avec des données plus rapides.

Gemini Ultra soutient techniquement la génération d’images. Mais cette capacité n’a pas encore fait son chemin dans la version productisée du modèle – peut-être parce que le mécanisme est plus complexe que la façon dont des applications telles que ChatGPT génèrent des images. Plutôt que d’alimenter un générateur d’images (comme DALL-E 3, dans le cas de ChatGPT), Gemini produit des images « nativement », sans étape intermédiaire.

Ultra est disponible en tant qu’API via Vertex AI, la plateforme de développement d’IA entièrement gérée de Google, et AI Studio, l’outil web de Google pour les développeurs d’applications et de plateformes.

Les capacités de Gemini Pro

Google dit que Gemini Pro est une amélioration par rapport à LaMDA dans ses capacités de raisonnement, de planification et de compréhension. La dernière version, Gemini 1.5 Pro – qui alimente les applications Gemini pour les abonnés Gemini Advanced – dépasse même les performances d’Ultra dans certains domaines.

Gemini 1.5 Pro est amélioré dans un certain nombre de domaines par rapport à son prédécesseur, Gemini 1.0 Pro, peut-être le plus clairement dans la quantité de données qu’il peut traiter. Gemini 1.5 Pro peut prendre jusqu’à 1,4 million de mots, deux heures de vidéo, ou 22 heures d’audio et peut raisonner ou répondre à des questions sur ces données (plus ou moins).

Gemini 1.5 Pro est devenu généralement disponible sur Vertex AI et AI Studio en juin en même temps qu’une fonctionnalité appelée exécution de code, qui vise à réduire les bogues dans le code généré par le affinage itératif ce code sur plusieurs étapes. (Le code d’exécution prend également en charge Gemini Flash.)

Au sein de Vertex AI, les développeurs peuvent personnaliser Gemini Pro dans des contextes spécifiques et des cas d’utilisation via un processus de réglage fin ou de « base de mise au point ». Par exemple, Pro (avec d’autres modèles Gemini) peut être chargé d’utiliser des données provenant de fournisseurs tiers tels que Moody’s, Thomson Reuters, zoomInfo et MSCI, ou des informations de source provenant d’ensembles de données d’entreprise ou de Google Search au lieu de sa banque de connaissances plus large. Gemini Pro peut également être connecté à des API externes et tierces pour effectuer des actions particulières, comme l’automatisation d’un flux de travail back-office.

AI Studio propose des modèles pour créer des invites de discussion structurées avec Pro. Les développeurs peuvent contrôler la gamme créative du modèle et fournir des exemples pour donner des instructions de ton et de style – ainsi que les paramètres de sécurité de Pro.

Vertex AI Agent Builder permet aux gens de construire des « agents » alimentés par les Gémeaux dans le cadre de Vertex AI. Par exemple, une entreprise pourrait créer un agent qui analyse les précédentes campagnes de marketing pour comprendre un style de marque et ensuite appliquer ces connaissances pour aider à générer de nouvelles idées compatibles avec le style.

Gemini Flash est plus léger mais emballe un coup de poing

Alors que la première version de Gemini Flash a été faite pour des charges de travail moins exigeantes, la version la plus récente, 2.0 Flash, est maintenant le modèle phare d’IA de Google. Google appelle Gemini 2.0 Flash son modèle d’IA pour l’ère de l’ère agentique. Le modèle peut générer nativement des images et de l’audio, en plus du texte, et peut utiliser des outils tels que Google Search et interagir avec des API externes.

Le modèle flash 2.0 est plus rapide que la génération précédente de modèles de Gemini et même surpasse certains des modèles Gemini 1.5 plus grands sur les benchmarks de mesure et d’analyse d’images. Vous pouvez essayer une version expérimentale de 2.0 Flash dans la version web de Gemini ou via les plateformes de développement de Google AI, et une version de production du modèle devrait atterrir en janvier.

Une ramification de Gemini Pro qui est petite et efficace, construite pour des charges de travail d’IA génératives étroites et à haute fréquence, Flash est multimodal comme Gemini Pro, ce qui signifie qu’il peut analyser l’audio, la vidéo, les images et le texte (mais il ne peut générer que du texte). Google dit que Flash est particulièrement bien adapté pour des tâches telles que la synthèse et les applications de chat, ainsi que le sous-titrage d’images et vidéo et l’extraction de données à partir de longs documents et tableaux.

Les développements utilisant Flash et Pro peuvent éventuellement exploiter la mise en cache contextuelle, ce qui leur permet de stocker de grandes quantités d’informations (par exemple, une base de connaissances ou une base de données de documents de recherche) dans un cache auquel les modèles Gemini peuvent accéder rapidement et relativement à moindre coût. La mise en cache contextuelle est toutefois une redevance supplémentaire en plus des autres frais d’utilisation du modèle Gemini.

Gemini Nano peut fonctionner sur votre téléphone

Gemini Nano est une version beaucoup plus petite des modèles Gemini Pro et Ultra, et il est assez efficace pour fonctionner directement sur (certains) appareils au lieu d’envoyer la tâche à un serveur quelque part. Jusqu’à présent, Nano alimente quelques fonctionnalités sur le Pixel 8 Pro, le Pixel 8, le Pixel 9 Pro, le Pixel 9 et le Samsung Galaxy S24, y compris Summarize in Recorder et Smart Reply dans Gboard.

L’application Recorder, qui permet aux utilisateurs d’appuyer sur un bouton pour enregistrer et transcrire l’audio, comprend un résumé alimenté par Gemini des conversations enregistrées, des interviews, des présentations et d’autres extraits audio. Les utilisateurs reçoivent des résumés même s’ils n’ont pas de signal ou de connexion Wi-Fi – et dans un cran à la vie privée, aucune donnée ne laisse leur téléphone en cours de traitement.

Nano est également dans Gboard, le remplacement du clavier de Google. Là, il alimente une fonctionnalité appelée Smart Reply, qui aide à suggérer la prochaine chose que vous voudrez dire lorsque vous aurez une conversation dans une application de messagerie telle que WhatsApp.

Dans l’application Google Messages sur les appareils pris en charge, Nano lecteur Magic Compose, qui peut créer des messages dans des styles tels que « excité », « formel » et « ludique ».

Google dit qu’une future version d’Android va taper Nano pour alerter les utilisateurs d’escroqueries potentielles pendant les appels. La nouvelle application météo sur les téléphones Pixel utilise Gemini Nano pour générer des rapports météorologiques personnalisés. Et TalkBack, le service d’accessibilité de Google, utilise Nano pour créer des descriptions auditives d’objets pour les utilisateurs à faible vision et à l’aveugle.

Combien coûtent les modèles Gemini ?

Gemini 1.0 Pro (la première version de Gemini Pro), 1.5 Pro et Flash sont disponibles via l’API Gemini de Google pour la construction d’applications et de services, le tout avec des options gratuites. Mais les options gratuites imposent des limites d’utilisation et laissent de côté certaines caractéristiques, comme la mise en cache contextuelle et le lot.

Les modèles Gemini sont par ailleurs pay-as-you-go. Voici le prix de base – à l’exclusion des add-ons comme la mise en cache contextuelle – en septembre 2024 :

- Géme 1,0 Pro : 50 cents pour 1 million de jetons d’entrée, 1,50 dollar pour 1 million de jetons de sortie

- Géme 1,5 Pro : 1,25 dollar pour 1 million de jetons d’entrée (pour les jetons d’entrée jusqu’à 128 000) ou 2,50 dollars pour 1 million de jetons d’entrée (pour les messages d’entrée supérieurs à 128 000 jetons); 5 dollars pour 1 million de jetons de sortie (pour les jetons de sortie jusqu’à 128 000 dollars) ou 10 dollars pour 1 million de jetons de sortie (pour les jetons de sortie supérieurs à 128K)

- Gémeaux 1,5 Flash : 7,5 cents pour 1 million de jetons d’intrants (pour les jetons d’entrée jusqu’à 128K), 15 cents pour 1 million de jetons d’entrée (pour les messages d’invites supérieures à 128K jetons), 30 cents par 1 million de jetons de production (pour les messages d’invite allant jusqu’à 128 000 jetons), 60 cents par 1 million de jetons de sortie (pour les jetons de 128 000)

- Gemini 1,5 Flash-8B : 3,75 cents pour 1 million de jetons d’entrée (pour les jetons d’invites jusqu’à 128K), 7,5% pour 1 million de jetons d’entrée (pour les messages d’invite de plus de 128K), 15 cents pour 1 million de jetons de sortie (pour les jetons de sortie jusqu’à 128K), 30 cents pour 1 million de jetons de sortie (pour les jetons de production supérieurs à 128K)

Les jetons sont des éléments subdivisés de données brutes, comme les syllabes « fan », « ta » et « tic » dans le mot « fantastique »; 1 million de jetons équivaut à environ 700 000 mots. La contribution fait référence aux jetons introduits dans le modèle, tandis que la sortie fait référence aux jetons que le modèle génère.

Les prix Ultra et 2.0 Flash n’ont pas encore été annoncés, et Nano n’a pas encore un accès anticipé.

Quelle est la dernière en date du projet Astra ?

Le projet Astra est l’effort de Google DeepMind pour créer des applications et des «agents » alimentés par l’IA pour une compréhension multimodale en temps réel. Dans les démos, Google a montré comment le modèle d’IA peut traiter simultanément la vidéo en direct et l’audio. Google a publié une version applicative du projet Astra à un petit nombre de testeurs de confiance en décembre, mais n’a pas l’intention d’une version plus large à l’heure actuelle.

La société aimerait mettre le projet Astra dans une paire de lunettes intelligentes. Google a également donné un prototype de certaines lunettes avec le Projet Astra et des capacités de réalité augmentée à quelques testeurs de confiance en décembre. Cependant, il n’y a pas de produit clair à l’heure actuelle, et il n’est pas clair quand Google publierait quelque chose comme ça.

Le projet Astra n’est toujours que cela, un projet, et non un produit. Cependant, les démos d’Astra révèlent ce que Google voudrait que ses produits d’IA fassent à l’avenir.

Gémeaux arrive-t-il sur l’iPhone ?

C’est peut-être le pu

Apple a déclaré qu’il est en pourparlers de mettre Gemini et d’autres modèles tiers à utiliser pour un certain nombre de fonctionnalités dans sa suite Apple Intelligence. À la suite d’une présentation au WWDC 2024, le vice-président d’Apple, Craig Federighi, a confirmé son intention de travailler avec des modèles, y compris Gemini, mais il n’a pas divulgué de détails supplémentaires.

Ce billet a été publié à l’origine le 16 février 2024, et a depuis été mis à jour pour inclure de nouvelles informations sur Gemini et les plans de Google à cet effet.

Par Tech7 Africa Magazine pour source Techcrunch